线性代数的本质(一):向量的本质 - 不仅仅是箭头

引言:向量——现代科学的通用语言

当你第一次接触向量时,老师可能告诉你:"向量就是一个箭头"或"向量就是一组有序的数"。这些说法都对,但都只触及了表面。

真正的问题是:为什么物理学家、工程师、数据科学家、量子物理学家,甚至经济学家,都在使用同一个数学概念——向量?这绝非偶然。

向量之所以如此普遍,是因为它捕捉了一个深刻的本质:线性性。我们的宇宙,在许多情况下,遵循着"可叠加性"的原则: - 两个小位移的叠加等于总位移(几何) - 两个小信号的叠加等于合成信号(信号处理) - 两个量子态的叠加仍是量子态(量子力学)

这种"可叠加性"——或者说线性性——是向量空间的核心。

本章的哲学立场

我们将从四个层次递进式地理解向量:

- 现象层:向量作为具体的物理量和数据

- 几何层:向量作为空间中的点和箭头

- 代数层:向量作为满足运算规则的对象

- 抽象层:向量空间的公理化结构

每一层都建立在前一层的基础上,但又超越了前一层的局限。最终,你会看到向量不是某种具体的"东西",而是一种数学模式(pattern)——一种描述"可以线性叠加的对象"的统一框架。

为什么需要这样的深度?

表面的理解足以应付考试,但深刻的理解才能: - 在遇到新问题时,识别出隐藏的向量空间结构 - 将不同领域的知识融会贯通(量子态、信号、数据都是向量) - 理解为什么某些算法有效(因为它们尊重向量空间的结构)

让我们开始这趟旅程。

一、几何视角:向量生活的空间

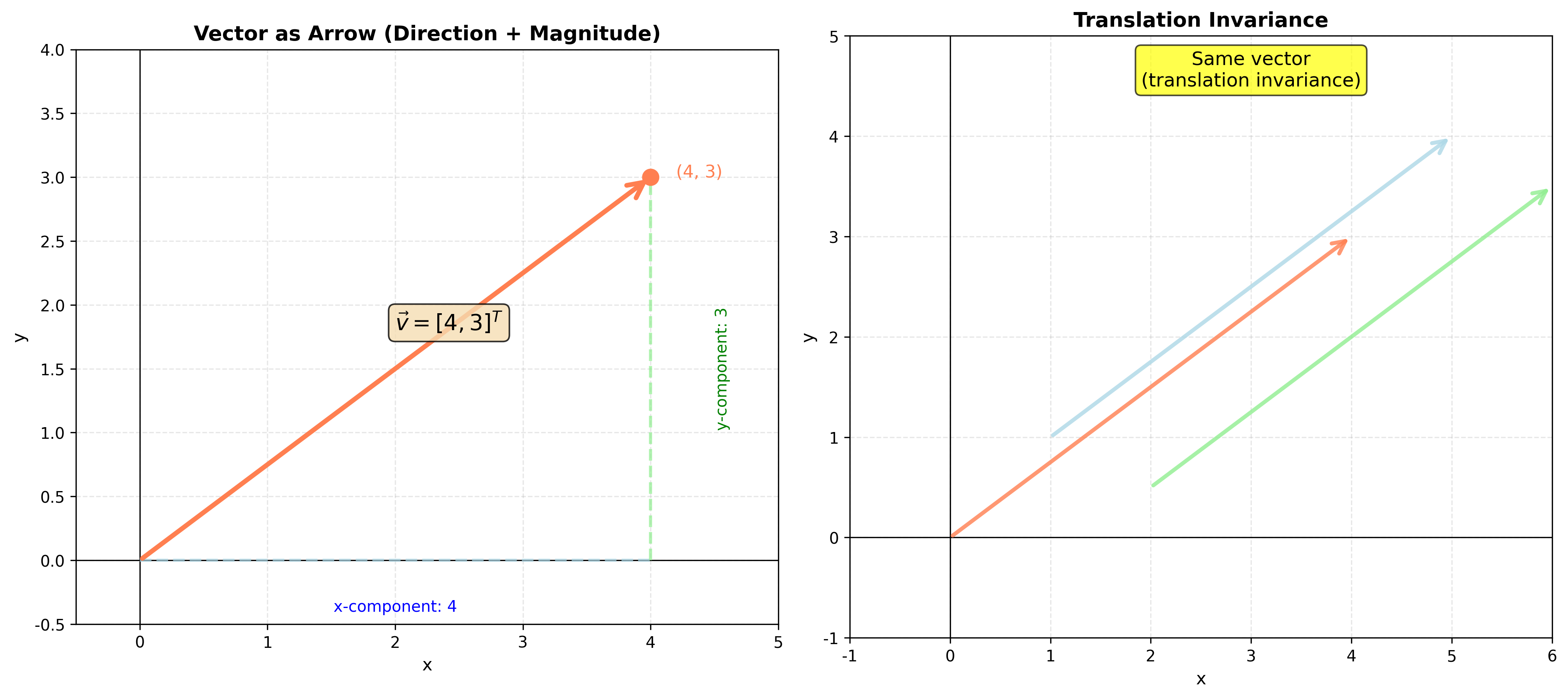

1.1 向量的诞生:从点到箭头

让我们从一个具体场景开始。假设你站在公园的中心点(原点),你的朋友告诉你:"向北走 3 步,然后向东走 4 步"。这个指令就是一个向量!

为什么这是一个向量?因为它包含了两个关键信息:

- 方向:先北后东(或者说,总体方向是东北方向)

- 位移:从起点到终点的距离

在数学上,我们把这个向量写成:

这里的 4 代表向东( x 方向)的分量, 3 代表向北( y 方向)的分量。

向量的长度(模)

走完这些步数后,你离原点有多远?这就是向量的模(

magnitude)或长度:

这不就是勾股定理吗?没错!向量的模就是直角三角形的斜边长度。

向量的方向

向量的方向可以用角度来表示。如果我们以正东方向为 0

度,逆时针为正方向:

所以你的朋友实际上让你往东偏北约 37 度的方向走了 5 步。

1.2 向量的平移不变性

这里有一个重要的概念:向量不关心起点在哪里。

无论你是从公园中心出发,还是从公园东北角出发,"向东 4 步、向北 3 步"这个指令都是同一个向量。这就是向量的平移不变性。

想象你在一艘船上,船以某个速度向东行驶。无论这艘船在太平洋中央还是在地中海,速度向量都是一样的——方向是东,大小是某个具体的速度值。船的位置变了,但速度向量没变。

这个性质在物理学中非常重要。力、速度、加速度都是向量,它们不依赖于具体的位置,只依赖于方向和大小。

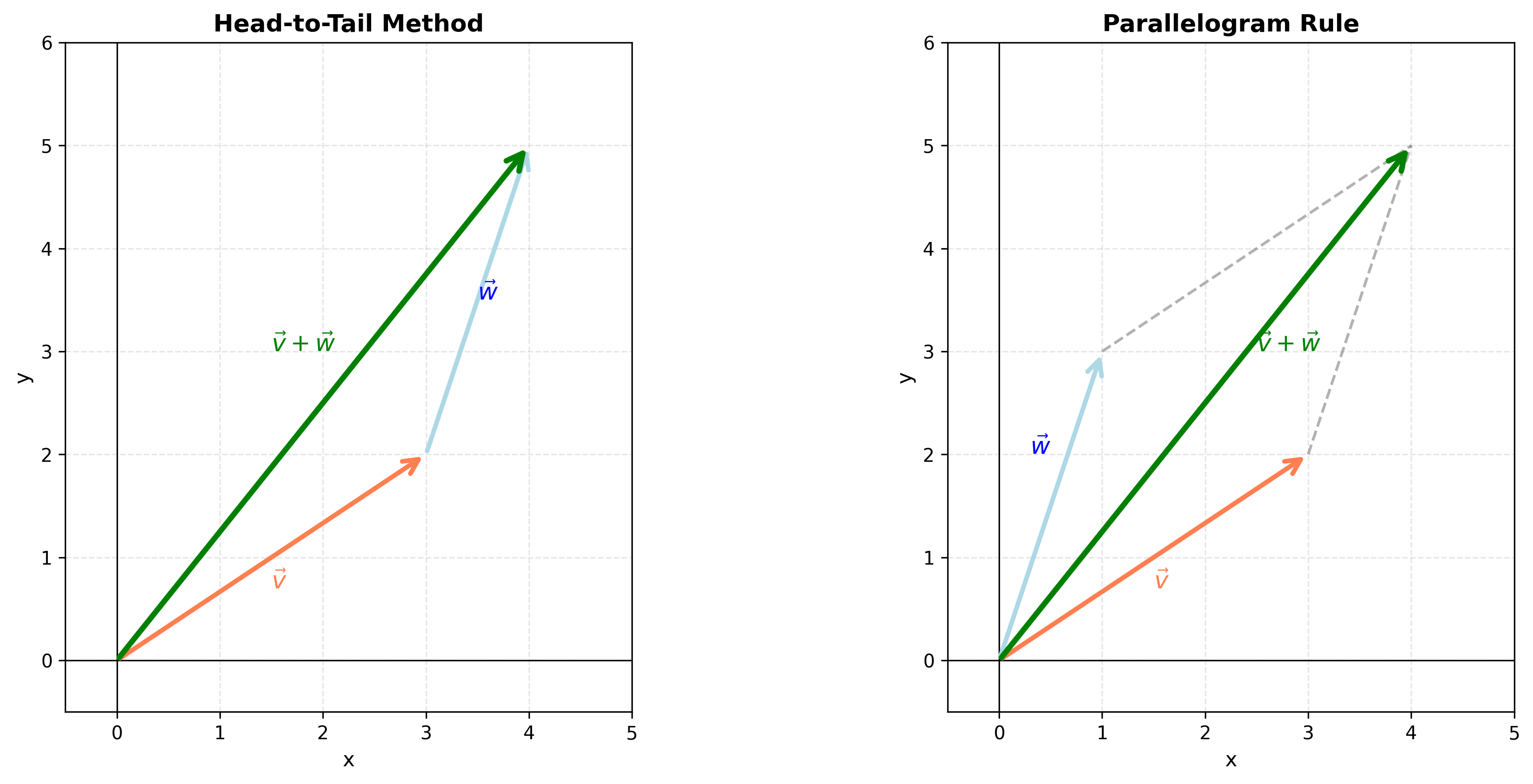

1.3 向量的加法:多种理解方式

向量加法可能是最重要的向量运算。让我从三个角度来解释它。

角度 1:头尾相接法

假设你先按向量

答案是:把

例子:你先向东走 3 步、向北走 4 步(向量

总位移是向东 4 步、向北 6 步。

角度 2:平行四边形法则

如果你从原点同时画出

这个法则在物理学中用得很多。比如,当两个力同时作用于一个物体时,合力就是这两个力向量的平行四边形对角线。

角度 3:分量相加

从代数角度看,向量加法就是对应分量相加:

这三种理解方式完全等价,但在不同场景下各有优势。几何直觉帮助你建立空间感,代数方法方便计算。

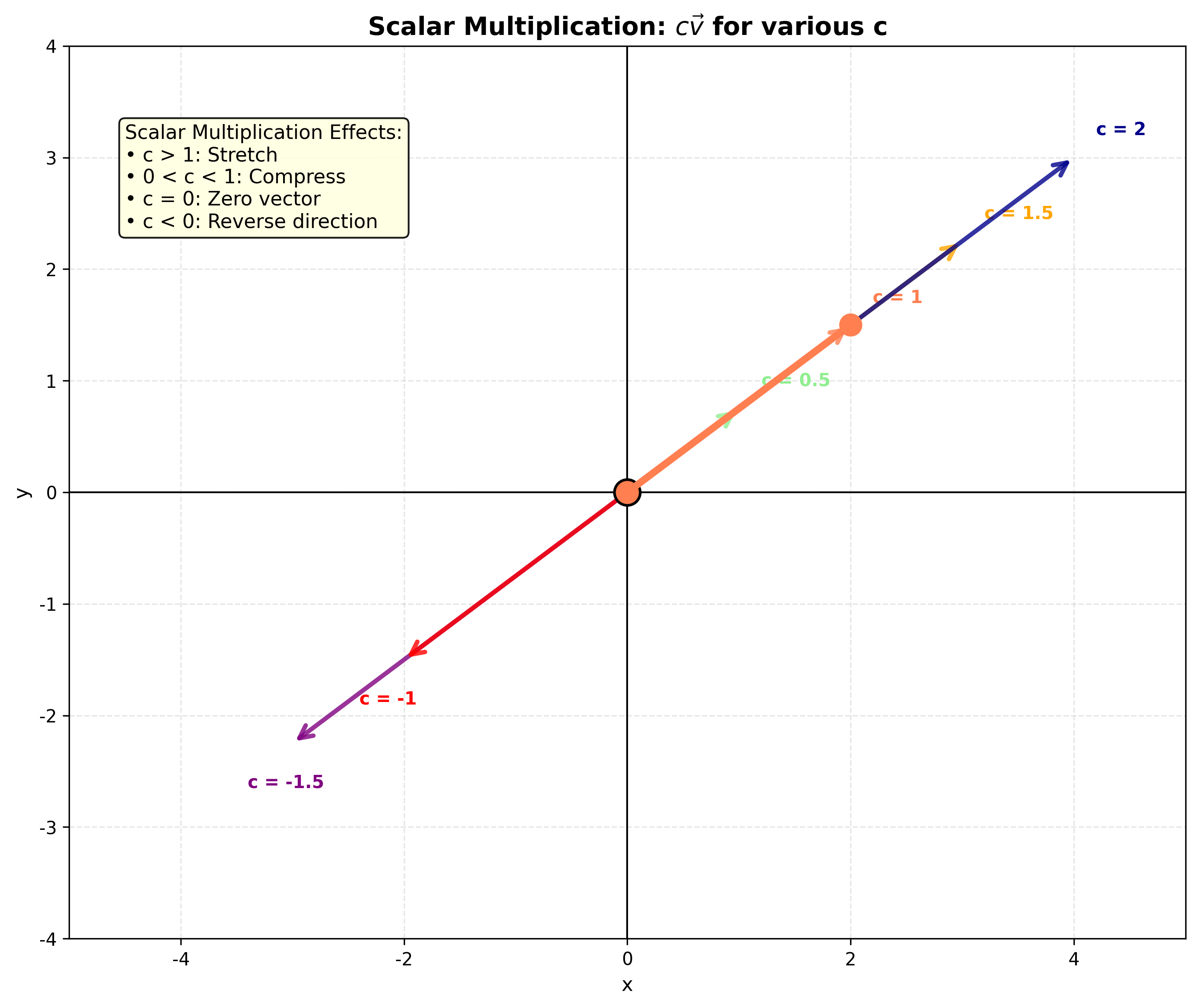

1.4 数乘:拉伸、压缩与反转

当我们说"

几何上,

更一般地,对于标量

- 当

- 当

- 当

- 当

生活中的例子:

想象你以

-

代数上,数乘就是每个分量都乘以这个标量:

1.5 向量减法:方向性的差异

向量减法可以理解为"从一个位置到另一个位置的位移"。

如果

是从点 A 指向点 B 的向量。

关键洞察:

这在计算机图形学中非常重要。比如,要计算子弹从枪口飞向目标的方向,就需要用目标位置减去枪口位置。

二、数值视角:向量作为数据的容器

2.1 超越二维和三维

到目前为止,我们讨论的都是可以画出来的 2D 或 3D 向量。但向量的真正力量在于它可以推广到任意维度。

一个

虽然我们无法直观"看到"高维向量,但所有的运算法则(加法、数乘、内积等)都完全一样地适用。

2.2 向量无处不在:真实世界的案例

案例 1:气象数据

某地某时刻的天气状况可以表示为一个向量:

其中各分量分别是:

- 温度: 25.3 ° C

- 湿度: 65.0%

- 气压: 1013 hPa

- 风速: 15.2 km/h

- 云量: 45%

这样,天气就变成了一个 5 维向量。如果我们收集多天的数据,就得到了一组向量,可以用来分析天气模式、预测未来天气。

案例 2:图像就是巨大的向量

一张

这就是为什么机器学习可以处理图像——它把图像当作向量,用向量运算来分析和分类!

1 | # 一个简单的例子 |

案例 3:推荐系统中的用户向量

Netflix 、 Spotify 等推荐系统把用户的偏好表示为向量:

1 | # 用户对 5 部电影的评分( 1-5 分, 0 表示未看) |

这个例子揭示了一个深刻的洞察:相似度可以用内积来度量!

案例 4:自然语言处理中的词向量

现代 NLP 将每个单词表示为一个向量(通常是 100-300

维)。神奇的是,这些向量能够捕捉语义关系:

这意味着"国王"和"女王"的关系,与"男人"和"女人"的关系是类似的!

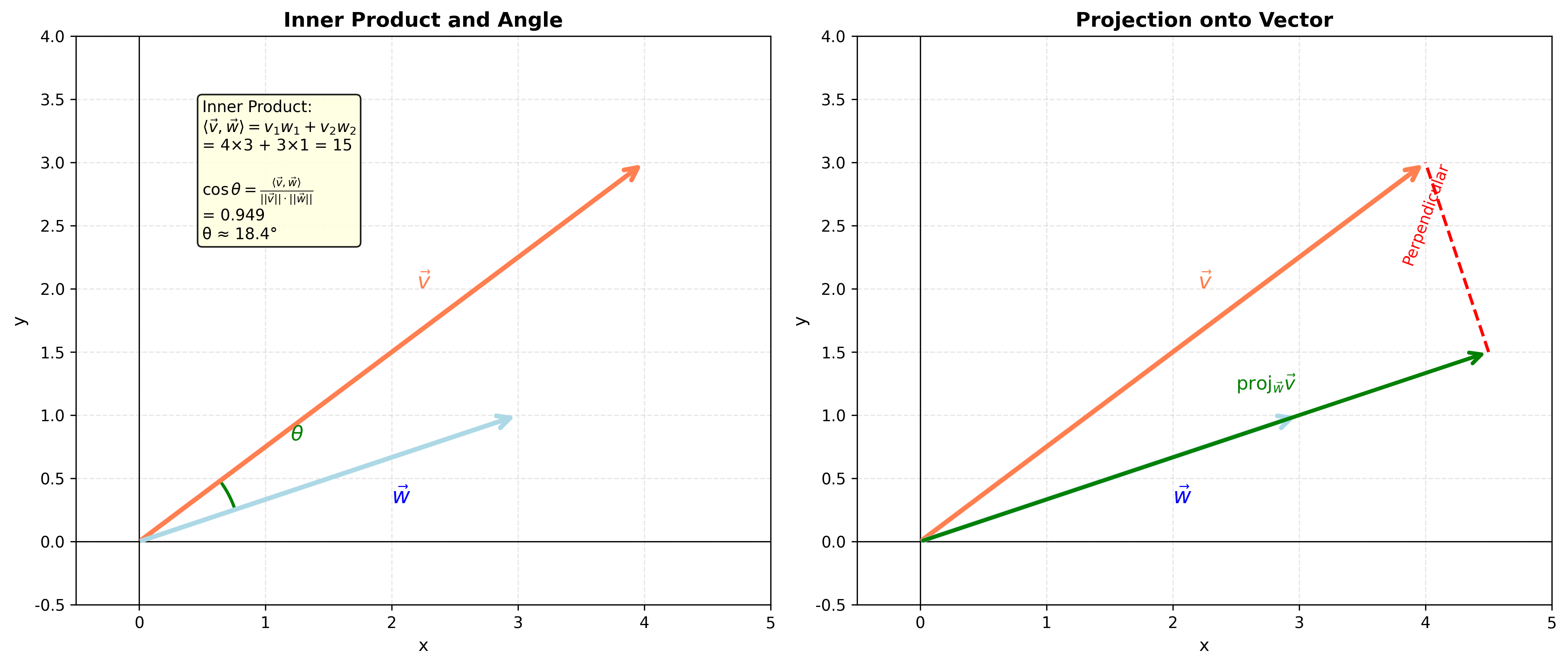

2.3 向量的内积:几何、代数与哲学的统一

内积是线性代数中最深刻的概念之一。它不仅是一个计算工具,更是连接几何与代数的桥梁。

内积的三层定义

层次1:计算定义(代数)

这是计算方法,但没有告诉你"为什么"。

层次2:几何定义

这个惊人的公式揭示了内积的几何本质:它度量了两个向量的"对齐程度"。

层次3:公理化定义(最抽象)

一个内积是满足以下公理的双线性映射

- 正定性:

- 对称性:

- 线性性(第一参数):

任何满足这三条公理的"乘法"都是内积!

Cauchy-Schwarz 不等式:内积的深刻约束

定理(Cauchy-Schwarz):对任意向量

等号成立当且仅当

证明(优美的代数技巧):

考虑函数

展开:

这是关于

整理得 Cauchy-Schwarz 不等式。

深层含义:

这个不等式说明,两个向量的内积永远不能超过它们长度的乘积。几何上,

三角不等式:向量的"绕路定理"

定理:

几何意义:三角形两边之和大于第三边(绕路比直走远)

证明(利用 Cauchy-Schwarz):

开方即得。

正交性:独立性的几何化

两个向量

为什么正交如此重要?

- 几何:正交向量"完全独立",互不干扰

- 代数:正交基使计算极其简化

- 概率:独立随机变量对应正交向量(协方差=0)

- 物理:正交方向上的分量可以独立处理

深层洞察:正交性是"无关性"的数学化。当两个向量正交时,一个向量的任何变化都不会影响另一个向量方向上的投影。

投影:最佳近似的几何形式

向量

深刻定理:

证明:设

由勾股定理(对正交向量):

因此

哲学意义:投影不只是"阴影",它是最佳线性近似的原型。最小二乘法、PCA、信号滤波都是这个思想的推广!

内积诱导的度量空间

有了内积,我们可以定义: - 范数:

这三个概念从内积自然涌现,形成了完整的几何结构。这就是为什么内积空间(Hilbert空间)是现代分析学的基础!

2.4 向量的范数:测量大小的哲学

2.4 向量的范数:测量大小的哲学

除了我们熟悉的"长度"( 2-范数),向量还有其他的"大小"度量方式。但为什么会有多种"大小"?这背后有深刻的数学和哲学原因。

范数的公理化定义

一个函数

- 正定性:

- 齐次性:

- 三角不等式:

任何满足这三条的"测量方式"都是合法的范数!

常见范数及其深层含义

- 几何意义:最短路径长度(直线距离)

- 物理意义:能量的度量(

- 统计意义:均方根( RMS)

- 为什么常用:与内积结构紧密联系,保持旋转不变性

- 几何意义:城市街道距离(只能沿坐标轴走)

- 统计意义:绝对离差和

- 优化特性:鼓励稀疏解(许多分量为0)

- 应用:LASSO 回归、压缩感知

- 含义:"最坏情况"的度量

- 应用:控制理论、鲁棒优化

- 极限意义:

当

范数的等价性定理

深刻定理:在有限维空间

含义:不同的范数给出的"大小"虽然数值不同,但在定性上是一致的。一个向量在某个范数下"大",在其他范数下也"大"。

为什么这很重要?因为它保证了收敛性、连续性等拓扑性质不依赖于范数的选择!

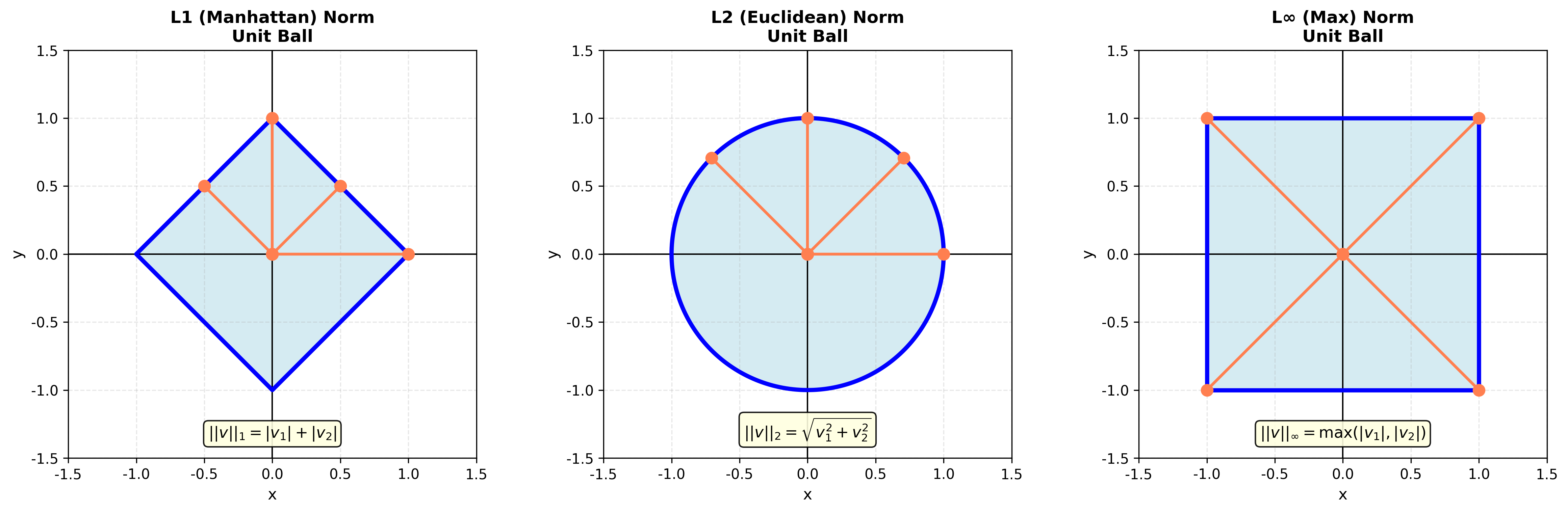

单位球:范数的几何指纹

不同范数的"单位球"(所有长度为1的向量)形状不同:

-

这些形状反映了范数的本质特征!

为什么需要不同的范数?

数学原因:不同的范数诱导不同的几何结构

实用原因:不同问题的"最优解"在不同范数下有不同性质

-

深层哲学:范数的选择反映了我们对"什么是重要的"的价值判断

三、抽象视角:向量空间的公理化——数学的威力

到目前为止,我们一直在讨论"一列数字"这种具体的向量。但真正的数学深度在于抽象化。

3.1 为什么需要公理化?哲学基础

在19世纪末,数学家面临一个困境:几何、代数、分析中都出现了类似的"线性结构",但它们看起来完全不同: - 几何中的向量是箭头 - 代数中的向量是数组 - 分析中的函数也有类似性质

关键洞察(Hilbert, Banach, 20世纪初):

这些看似不同的对象,其实遵循相同的结构规则。如果我们把这些规则提炼出来,作为"公理",那么所有满足公理的对象都可以统一处理!

这就是公理化方法的威力:从具体到抽象,从特殊到一般。

3.2 向量空间的严格定义

一个向量空间(Vector Space)

- 向量加法:

- 标量乘法:

必须满足以下十条公理:

设

加法结构(Abel群):

- 封闭性:

- 交换律:

- 结合律:

- 零元存在:

- 逆元存在:

标量乘法与加法的相容性:

- 数乘封闭性:

- 数乘分配律:

- 域分配律:

- 结合律:

- 单位元:

关键观察:这些公理不是随意选择的!它们是从大量具体例子中提炼出的最小公共结构。

3.3 惊人的推论:零向量的唯一性

定理:向量空间中的零向量是唯一的。

证明:假设有两个零向量

由

因此

哲学意义:这个简单的定理展示了公理的力量——从十条规则,我们可以推导出新的事实!

3.4 意想不到的向量空间——数学的统一性

例 1:连续函数空间

所有定义在

- 加法:

- 数乘:

- 零向量:

内积定义:

这是无穷维向量空间!函数

深层联系: - Fourier级数:函数分解为三角函数的"线性组合" - 正交多项式:Legendre、Chebyshev多项式形成正交基 - 量子力学:波函数生活在无穷维Hilbert空间中

例 2:多项式空间

次数

标准基:

多项式

另一组基(Lagrange基):

其中

为什么有多组基?不同的基适用于不同的问题! - 单项式基:微分方便 - Lagrange基:插值方便 - Chebyshev基:逼近最优

例

3:矩阵空间

Frobenius内积:

特殊子空间: - 对称矩阵:

深层观察:

例 4:解空间的深层结构

齐次线性方程组

关键定理(秩-零化度定理):

这个深刻的定理说明: - 矩阵的秩(列空间维度) - 零空间的维度 - 两者之和等于列数

非齐次方程

一个特解 + 零空间 = 全部解

例 5:量子态空间(物理的抽象)

在量子力学中,一个粒子的态由复向量空间中的单位向量表示(Hilbert空间

叠加原理:如果

这就是量子力学的"诡异"之处——态的叠加!薛定谔的猫同时处于"活"和"死"的叠加态。

内积(Dirac记号):

测量两个态的"相似度"或"跃迁概率"。

3.5 为什么抽象如此强大?

抽象的力量在于:

- 统一性:一次证明,无限应用

- 可迁移性:在一个领域的洞察可以迁移到另一个领域

- 预测性:公理可以预测未发现的性质

具体例子:Cauchy-Schwarz 不等式对所有内积空间成立:

- 数值向量:

同一个定理,三个不同领域!这就是抽象的威力。

3.6 从向量空间到内积空间再到Hilbert空间

数学抽象是分层的:

向量空间 → 只有加法和数乘 ↓ 加入内积 内积空间 → 有几何概念(长度、角度) ↓ 加入完备性 Hilbert空间 → 极限过程收敛(无穷维也OK)

每一层都比前一层更丰富。量子力学需要 Hilbert 空间,因为波函数是无穷维的!

四、深层应用:向量思维在现代科学中的核心地位

向量不仅是数学工具,更是现代科学的思维方式。让我们看看向量如何在不同领域发挥作用。

4.1 量子力学:态向量与叠加

在量子力学中,每个物理态都是Hilbert空间中的向量。

自旋-1/2粒子的态空间:

这里

深刻之处: -

测量之前,粒子处于叠加态(同时"向上"和"向下") -

测量后,态"坍缩"到某个基向量 -

数学结构: - 态空间:复向量空间

4.2 信号处理:时间序列作为向量

一段长度为

Fourier变换的向量空间解释:

信号可以分解为正交的频率分量:

这是向量

内积的物理意义:

测量两个信号的"相似度"或"相关性"。

应用: - 音频压缩( MP3):去掉小的Fourier系数 - 图像去噪:保留主要频率分量 - 通信系统:信号检测与匹配滤波

4.3 机器学习:特征向量与分类

在监督学习中,每个样本都是一个向量。

例子:手写数字识别

一张

线性分类器:

决策边界是超平面

几何解释: -

支持向量机( SVM):

找到使"间隔"最大化的超平面,转化为优化问题:

纯粹的向量几何!

4.4 优化理论:梯度向量

在优化问题中,梯度是核心概念。

定义:函数

深刻性质:

证明(方向导数):

当

梯度下降法:

沿着梯度的反方向走,函数值下降最快!

深度学习中的反向传播:本质上是高维向量的链式法则,计算损失函数关于百万级参数的梯度向量。

4.5 经济学:Leontief 投入产出模型

考虑一个有

平衡方程:

解得:

经济解释:为了满足最终需求

这是向量方程,解决实际经济问题!

4.6 PageRank:网页排序的向量算法

Google 的 PageRank 算法把网页排序问题转化为特征向量问题。

设有

PageRank向量

这是特征值

深层含义:PageRank 是稳态分布——随机游走者长期停留在各页面的概率。

4.7 生物学:基因表达谱

在基因组学中,一个细胞的"状态"可以用基因表达向量描述:

每个分量

应用: - 聚类:表达谱相似的细胞聚成一类(癌细胞 vs 正常细胞) - 降维:用 PCA 将 20000 维降到 2-3 维可视化 - 差异分析:比较两组样本的表达向量差异

内积的生物意义:

度量两个细胞在基因表达模式上的相似性。

五、实战应用

5.1 GPS 定位原理简化版

GPS 如何确定你的位置?核心是三点定位。

假设在 2D 平面上有三个卫星,位置分别是

你的位置

这三个方程对应三个圆。三个圆的交点就是你的位置!

实际的 GPS 使用 4 颗卫星(因为是 3D 空间),还要考虑时钟误差,但基本原理是一样的。

5.2 游戏物理引擎

在游戏中,物体的运动由向量描述:

1 | # 物体状态 |

这就是牛顿力学的离散化版本!所有的物理模拟都建立在向量运算的基础上。

5.3 颜色空间

计算机中的颜色通常表示为 3 维向量( RGB):

1 | red = np.array([255, 0, 0]) |

颜色的混合就是向量的运算!

六、常见误区与澄清

误区 1:向量必须从原点出发

错误:向量必须从原点(0,0)开始画。

正确:向量只有方向和大小,没有固定位置。从任何点出发画的同一个向量都是"相同"的(平移不变性)。

误区 2:向量就是一列数字

部分正确:在坐标系中,向量可以用一列数字表示。但"向量"的本质是一个抽象概念,数字只是其中一种表示方式。函数、多项式、甚至更抽象的数学对象都可以是向量。

误区 3:内积和外积是类似的运算

错误:它们完全不同!

- 内积(点积):结果是一个标量,

- 外积(叉积):结果是一个向量,

误区 4:零向量没有方向

正确但需要注意:零向量

五、历史与哲学:向量概念的演变

5.1 从几何直觉到代数形式(1800-1900)

向量的概念经历了漫长而曲折的发展。

早期:几何阶段 - Euler, Gauss(18世纪):用"有向线段"表示力和速度,但没有系统的代数 - 复数的几何表示(Wessel, Argand, 1797-1806):复数平面暗示了二维向量的可能性

革命性突破:三位先驱

- Hamilton(1843):四元数的发明

- 试图推广复数到三维

- 发现必须放弃交换律:

- 向量是四元数的"纯虚部"

- 定义了点积和叉积(虽然名字不同)

- Grassmann(1844):外代数(Exterior Algebra)

- 《扩张论》( Die Ausdehnungslehre)

- 最接近现代向量空间的思想

- 定义了

- 太超前,当时几乎无人理解

- Gibbs(1881-1884):现代向量记号

- 从Hamilton四元数中提炼出三维向量

- 引入

- 写了《向量分析》教材,传播给物理学家和工程师

为什么是 Gibbs 的记号流行了? - 简单实用,符合物理直觉 - Maxwell方程组用向量写更简洁 - 工程界广泛采用

5.2 公理化与抽象化(1900-1930)

20世纪初:结构主义数学的兴起

- Hilbert(1900s):公理化方法,从几何公理到向量空间公理

- Banach(1920s):研究无穷维向量空间(Banach空间)

- von Neumann(1930s):Hilbert空间公理化,为量子力学奠基

关键转变:从"向量是什么"到"向量满足什么规则"

这是数学史上的范式转变——结构主义取代了本质主义。我们不再问"向量的本质是什么",而问"什么样的对象可以当作向量"。

5.3 哲学反思:为什么线性性如此普遍?

问题:为什么物理、工程、数据科学都用向量?

答案的层次:

层次1:实用主义 - 线性模型简单,容易计算 - 非线性问题可以局部线性化(泰勒展开)

层次2:数学结构 - 线性结构是"最简单的非平凡结构" - 只需加法和数乘,就能建立丰富的理论

层次3:自然界的秘密 - 叠加原理:许多物理定律是线性的 - 波的叠加(光、声、水波) - 量子态的叠加 - 电路的叠加定理 - 为什么自然界喜欢线性? - 能量最小原理往往导致线性方程(变分法) - 对称性+守恒律导致线性结构( Noether定理)

层次4:哲学猜想 - 也许"线性性"是我们认知世界的方式,而非世界的本质? - Kant:空间本身就是人类直觉的先验形式 - 现代观点:数学结构是人类心智与自然界交互作用的产物

5.4 向量的多重人格:符号的演变

不同学科的记号:

| 学科 | 记号 | 原因 |

|---|---|---|

| 物理学 | 强调几何性质 | |

| 工程学 | 手写方便 | |

| 计算机科学 | v 或 vec |

代码中不支持特殊符号 |

| 量子物理 | Dirac的狄拉克符号 | |

| 数学 | 简洁抽象 |

每种记号都反映了不同的思维方式!

5.5 未来:向量概念还在演化

当前前沿:

- 无穷维向量空间:函数空间、概率空间

- 赋范向量空间:Banach空间、Hilbert空间

- 拓扑向量空间:容许极限过程

- 范畴论视角:向量空间是某种范畴的对象

新应用: - 深度学习:向量嵌入( word2vec, BERT) - 量子计算:量子态是向量,量子门是矩阵 - 数据科学:高维数据的几何结构

向量的故事还在继续...

六、总结与深层洞察

本章的核心洞察

1. 三个层次的理解

现象层:向量是数据、物理量、几何对象 结构层:向量遵循线性规则(可加性、齐次性) 抽象层:向量空间是满足公理的代数结构

2. 内积的中心地位

内积不仅是一个运算,它赋予向量空间几何结构: -

长度(范数):

没有内积:向量空间只是代数结构 有了内积:向量空间变成几何空间(内积空间、Hilbert空间)

3. 线性性的哲学

线性性意味着: - 可加性:

这两条看似简单,但蕴含着深刻的对称性: - 整体等于部分之和(不产生"涌现") - 缩放输入等价于缩放输出(尺度不变性)

非线性:有相互作用、有涌现、有混沌 线性:可预测、可叠加、可分解

4. 统一的力量

向量思维统一了: - 几何(点、箭头) - 代数(方程、运算) - 分析(函数、极限) - 应用(物理、数据、优化)

一次学习,终身受用。

为什么要深刻理解向量?

为考试?不,为思维方式

深刻理解向量后,你会:

- 识别模式:在新问题中看到向量空间结构

- 这组对象可以"加法"吗?

- 有"零元素"吗?

- 有"内积"吗?

- 迁移知识:将一个领域的技巧用到另一个领域

- 信号处理的Fourier分析 → 图像压缩

- 量子力学的Hilbert空间 → 机器学习的核方法

- 优化中的梯度 → 深度学习的反向传播

- 欣赏美:数学的统一美、简洁美

- 一个公理系统,无穷应用

- 几何直觉与代数精确的完美融合

通往后续章节的路径

理解了向量(单个对象),我们将探索:

第2章:线性组合与向量空间 - 如何用向量"构建"整个空间? - 什么是维度的本质? - 线性独立为何重要?

第3章:矩阵作为线性变换 - 矩阵不是"数字表",而是"空间变换" - 如何用矩阵看待旋转、拉伸、投影?

第6章:特征值与特征向量 - 为什么某些向量在变换下方向不变? - 这与矩阵的"本质"有何关系?

第9章:奇异值分解( SVD) - 任何矩阵都可以分解为旋转+拉伸+旋转 - 这是PCA、推荐系统、图像压缩的核心

每一步都建立在向量的基础上。根基越深,大厦越高。

最后的思考

向量不仅是数学工具,更是一种看待世界的方式。

当你看到: - 一张图片,想到:这是一个百万维向量 - 一段音乐,想到:这是时间序列向量 - 一个推荐结果,想到:这是用户向量和物品向量的内积 - 一个物理现象,想到:这是向量场的演化

你就真正理解了向量的本质。

让我们继续这趟旅程。

练习题

基础计算题

- 向量运算:给定

- (a)

- (b)

- (c)

- (d)

- (e)

- (a)

- 投影计算:

- 计算向量

- 计算向量

- 验证残差向量

- 验证残差向量

- 用勾股定理验证:

- 用勾股定理验证:

- 正交性判断:判断以下向量对是否正交:

- (a)

- (b)

- (c)

- (a)

理论证明题

- Cauchy-Schwarz 不等式的应用:

- 用 Cauchy-Schwarz 证明:对任意

- 用 Cauchy-Schwarz 证明:对任意

- 证明:

- 证明:

- 应用到函数:证明

- 应用到函数:证明

- 三角不等式:

- 证明:

- 证明:

- 几何解释上述不等式

- 什么时候等号成立?

- 范数的性质:

- 证明

- 证明

- 证明对任意向量

- 证明对任意向量

- 找到向量使某个不等式达到等号

- 向量空间的验证:

- 证明所有

- 证明所有

- (b)

- 多项式

- 多项式

高级应用题

机器学习中的余弦相似度: 用户对5部电影的评分:

Alice:

Bob:

Carol:

- 计算 Alice 与 Bob、Carol 的余弦相似度

- 谁与 Alice 更相似?

- 如果忽略评分为0的电影,重新计算(只考虑共同评分)

- 设计一个算法预测 Alice 对未看电影的评分

最小二乘拟合: 给定数据点

提示:这等价于求

- 写出法方程

- 写出法方程

- 求解得到

- 求解得到

- 计算残差

- 计算残差

量子态的叠加: 考虑二能级系统(自旋-1/2),基态为

- 态

- 态

- 计算

- 计算

- 测量到

- 测量到

- 如果

- 如果

深度思考题

零向量的特殊性:

- 零向量与任何向量的内积为0,这是否意味着零向量与所有向量正交?

- 零向量的方向是什么?为什么说它"没有方向"?

- 在投影公式中,为什么要排除

- 在投影公式中,为什么要排除

内积的不同定义: 在

- 验证这满足内积的三条公理

- 在这个内积下,

- 在这个内积下,

- 计算向量

- 计算向量

- 画出"单位圆"(所有长度为1的向量)

函数作为向量的深入: 在

- 验证

- 验证

- 计算

- 计算

- 将函数

- 将函数

- 这与数据分析中的"去均值"有什么关系?

范数诱导的距离:

- 证明

- 证明

- 在

- 在

- 为什么说

- 为什么说

线性性的哲学:

- 举例说明生活中的非线性现象(向量加法不成立)

- 为什么大多数物理定律在小范围内可以线性近似?

- 量子力学的叠加原理是线性的,但为什么宏观世界看起来不是?

编程实战题

向量类的实现: 用 Python 实现一个

Vector类,支持:- 基本运算:

+,-,*(数乘),@(内积) - 范数:

norm(p=2),支持 - 角度:

angle(other) - 投影:

project_onto(other) - 正交化:

orthogonalize_against(other)

- 基本运算:

图像相似度计算:

- 读取两张图像,转换为向量

- 计算余弦相似度、

- 可视化:在二维空间中投影多张图像向量

Gram-Schmidt 正交化: 实现 Gram-Schmidt 算法,输入一组线性独立向量,输出正交(或标准正交)向量组:

1

2

3

4

5

6def gram_schmidt(vectors):

"""

Input: list of linearly independent vectors

Output: list of orthonormal vectors

"""

# Your code here测试:输入

PageRank 简化版: 给定网页链接关系(邻接矩阵),计算 PageRank:

- 构造转移矩阵

- 用幂迭代法求主特征向量

- 可视化:节点大小表示 PageRank 值

- 构造转移矩阵

主成分分析( PCA)预览:

- 生成二维数据(带噪声的直线)

- 计算协方差矩阵

- 找到主方向(最大方差方向,提示:这是协方差矩阵的特征向量)

- 可视化原始数据和主方向

参考资料

教材

- Strang, G. (2019). Linear Algebra and Learning from Data. Wellesley-Cambridge Press. —— MIT 线性代数课程教材

- Boyd, S., & Vandenberghe, L. (2018). Introduction to Applied Linear Algebra. Cambridge University Press. —— 应用导向的入门书

- Axler, S. (2015). Linear Algebra Done Right. Springer. —— 理论导向的经典教材

视频

- Sanderson, G. (2016). Essence of Linear Algebra. 3Blue1Brown YouTube Series. —— 可视化做得最好的线性代数系列

- Strang, G. MIT 18.06 Linear Algebra. MIT OpenCourseWare. —— Gilbert Strang 教授的经典课程

延伸阅读

- Goodfellow, I., Bengio, Y., & Courville, A. (2016). Deep Learning. MIT Press. Chapter 2. —— 深度学习视角的线性代数

Crowe, M. J. (1967). A History of Vector Analysis. University of Notre Dame Press. —— 向量概念的历史演变

本文是《线性代数的本质与应用》系列的第 1 章,共 18 章。 作者: Chen K. | 最后更新: 2024-01-05 如有问题或建议,欢迎在评论区讨论!

- 本文标题:线性代数(一)向量的本质

- 本文作者:Chen Kai

- 创建时间:2019-01-05 09:30:00

- 本文链接:https://www.chenk.top/%E7%BA%BF%E6%80%A7%E4%BB%A3%E6%95%B0%EF%BC%88%E4%B8%80%EF%BC%89%E5%90%91%E9%87%8F%E7%9A%84%E6%9C%AC%E8%B4%A8/

- 版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!